谷歌宣布开源多模态大模型 Gemma3:媲美DeepSeek,算力暴降,附亮点分析与安装指南

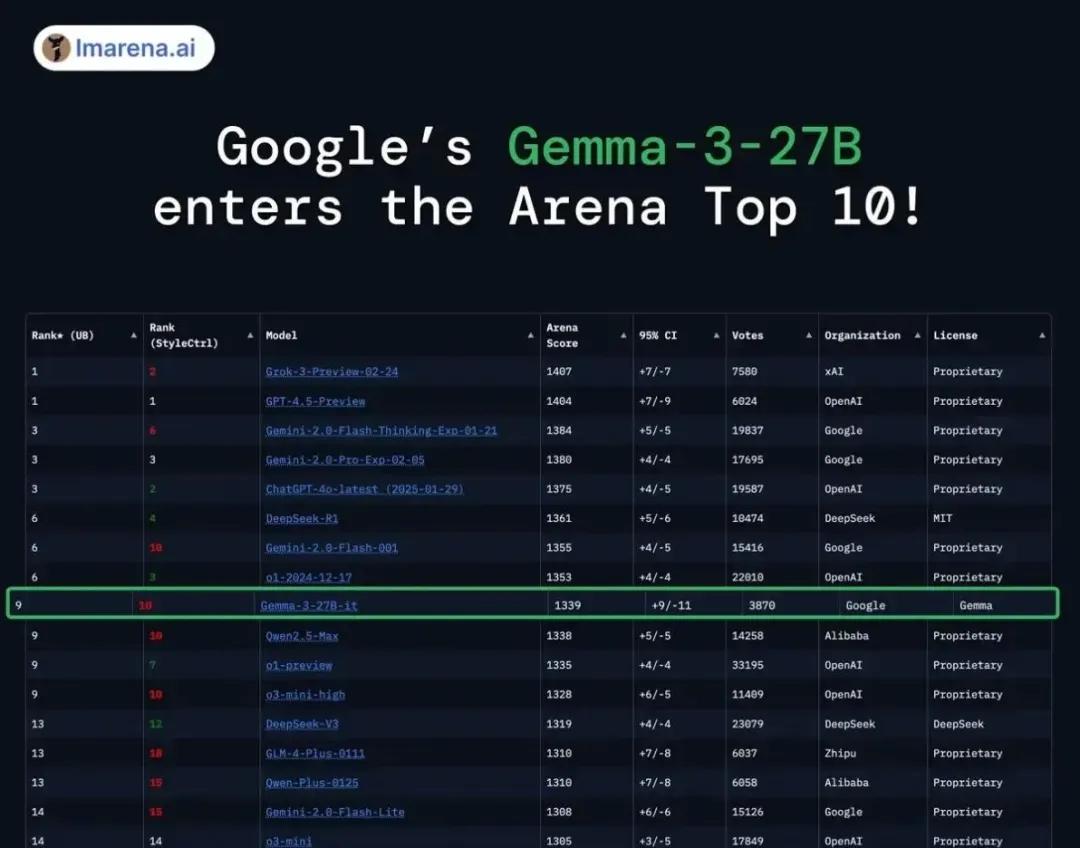

谷歌首席执行官Sundar Pichai宣布,开源最新多模态大模型Gemma-3,主打低成本高性能。Gemma-3共有10亿、40亿、120亿和270亿四种参数。但即便最大的270亿参数,只需要一张H100就能高效推理,同类模型要达到这个效果最少要提升10倍算力,也是目前最强小参数模型。根据盲测LMSYS ChatbotArena数据显示,Gemma-3仅次于DeepSeek的R1-671B,高于OpenAI的o3-mini,Llama3-405B等知名模型。

开源网址GitHub:

https://github.com/google-deepmind/gemma

https://huggingface.co/collections/google/gemma-3-release-67c6c6f89c4f76621268bb6d

主要特性

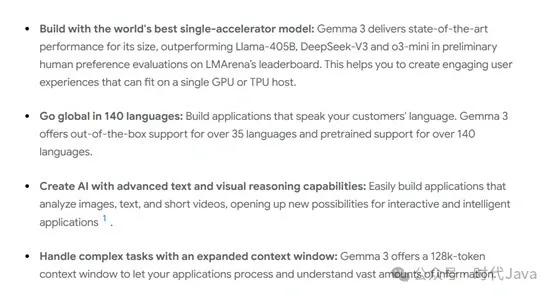

- • 多语言支持:覆盖 140+ 种语言

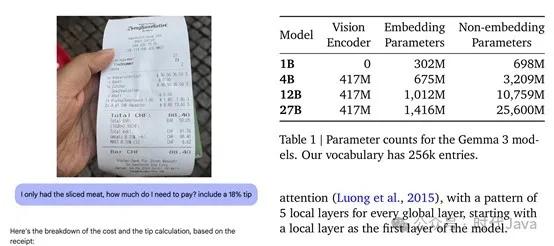

- • 多模态能力:增强文本理解及视觉处理,可解析文本、图片和短视频

- • 长文本处理:128K 上下文窗口

- • 高级功能:支持函数调用,适用于 AI 代理开发和自动化任务执行

- • 灵活部署:提供 1B、4B、12B 和 27B 四种规模,适配不同硬件环境

- • 广泛兼容:可在手机和电脑上运行

在性能测试方面,根据 LMSYS ChatbotArena 的盲测数据,Gemma-3 的表现仅次于 DeepSeek 的 R1-671B,优于 OpenAI 的 o3-mini 和 Llama3-405B 等知名模型。

Gemma-3-27B 模型在综合评测中位列前 10,超越多个专有模型,成为仅次于 DeepSeek-R1 的顶级开源模型。

Gemma-3架构与技术亮点

在架构设计上,Gemma-3采用了与前两代一样的通用解码器Transformer架构,但进行了众多创新和优化。

为了支持长上下文,Gemma-3模型将上下文长度扩展到了128Ktoken(10亿参数模型为32K)。模型提高了全局自注意力层的RoPE基础频率,从10k提升到1M,而局部层频率保持在10k。

同时,采用了类似位置插值的方法来扩展全局自注意力层的跨度,使模型在长上下文场景下能够更好地捕捉信息提升性能。

多模态能力是Gemma-3的一大技术亮点,能够同时处理文本和图像。还集成了定制版的SigLIP视觉编码器,这是一个基于VisionTransformer的编码器,通过CLIP损失的变体进行训练。

为了降低图像处理的推理成本,Gemma-3采用了创新的图像嵌入压缩技术,将视觉嵌入压缩为固定大小的256个向量,从而在不损失关键信息的前提下,显著减少了计算资源的消耗。

高效训练过程

在预训练阶段,Gemma-3采用了与Gemma 2相似的方法并融入新的改进。为适应图像和文本混合数据的训练需求,模型使用了比Gemma 2更大的token预算。

270亿参数的模型训练使用14Ttoken,120亿参数模型使用12T,40亿参数模型使用4T,10亿参数模型使用2T。

Gemma-3使用与Gemini2.0相同的SentencePiece分词器,具备分割数字、保留空格和字节级编码的特性,生成的词汇表包含262k个条目,使得模型在处理非英语语言时更加平衡。

Gemma-3使用与Gemini2.0相同的SentencePiece分词器,具备分割数字、保留空格和字节级编码的特性,生成的词汇表包含262k个条目,使得模型在处理非英语语言时更加平衡。

在训练优化上,Gemma-3运用知识蒸馏技术。每个token采样256个logits,按照教师概率进行加权,学生模型通过交叉熵损失来学习教师模型在这些样本中的分布。在这个过程中,对于未采样的logits,教师模型的目标分布被设为零概率并重新归一化,从而引导学生模型学习到更优的分布,提升模型的性能。

完成预训练后,Gemma-3进入后训练阶段,该阶段聚焦于提升模型的特定能力并整合新特性。后训练采用了改进版的知识蒸馏技术,从大型指令微调教师模型中获取知识,同时结合基于改进版BOND、WARM和WARP的强化学习微调阶段。

本地部署指南

1. 下载安装包

我们提供了便捷的安装包,涵盖各种模型规模。

安装包内容, 1B、4B、12B 和 27B 四种规模一键安装启动脚本,大家可以根据显存大小选择安装对应模型。

文件名模型大小用途

0-OllamaSetup.exe-Ollama 主程序,用于本地模型部署和运行

1-Run-gemma3-1b.bat815MB启动 Gemma3-1b 模型的脚本

1-Run-gemma3-4b.bat3.3GB启动 Gemma3-4b 模型的脚本

1-Run-gemma3-12b.bat8.1GB启动 Gemma3-12b 模型的脚本

1-Run-gemma3-27b.bat17GB启动 Gemma3-27b 模型的脚本

2-ChatWise_0.6.26_x64-setup.exe-ChatWise 图形界面程序,提供友好的交互环境

2. 安装 Ollama

运行,按提示完成安装。

3. 启动 Gemma3 模型

双击 (或其他规模的批处理文件):

本文系作者在时代Java发表,未经许可,不得转载。

如有侵权,请联系nowjava@qq.com删除。