没有独显也能部署本地大模型,英特尔酷睿 Ultra200H CPU 部署 DeepSeek

近年来,随着 AI 领域的火爆和对算力需求的持续飙升,市面主流独立显卡的算力也都在逐步提升。不过其实对于大多数普通用户对日常办公、生活而言,主力机其实仍旧是需要兼顾价格、便携性、性能等多方面考量的,一张“核弹级”的显卡,听起来很爽,但实际部署起来,无论是价格还是功耗,都难以称得上“日常”。

不过随着 AI 助手近年来的突破,越来越多的用户在日常工作、生活中,都开始大量使用 AI 作为助手。由互联网厂商部署在云端的 AI 服务,虽然门槛较低、使用方便,但要么有着访问次数等规则的限制,要么在频繁访问的情况下难以保证服务器的稳定。随着诸如 deepseek 等优秀大模型的开源,以及模型蒸馏带来的算力要求降低,不少 AI 的“高频用户”,开始考虑在本地部署一个专属于自己的 AI 助理。

本地运行大模型这事儿,听起来好像怎么都不会和“轻薄本”搭边儿,不过随着英特尔 ® 酷睿™ Ultra200H 系列处理器的发布和优化,让这件事儿不仅有了可能,甚至体验还可以相当不错。

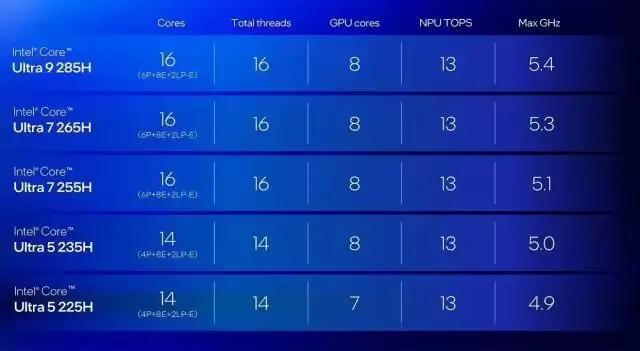

先来简单介绍下这款处理器,其采用混合架构设计,包括 4-6 个 P-Core(性能核)、八个 E-Core(效率核)和两个 LP E-Core(低功耗效率核),相较前代产品,多线程性能提升了高达 41%,适合低延迟 AI 工作负载。

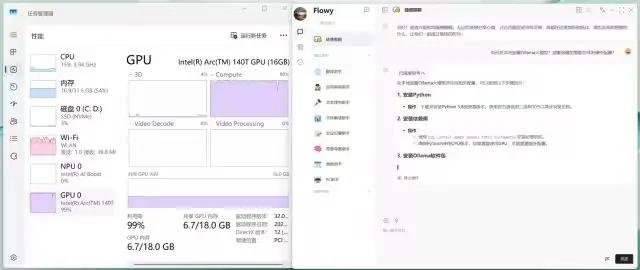

对于在大模型的应用方面,英特尔 ® 酷睿™ Ultra200H 系列处理器的 GPU 集成了 Xe 架构,AI 算力显著提升,且其全系配备了独立 NPU,NPU 单元可提供高达 13 TOPS 的算力,通过 CPU+GPU+NPU 的协同计算,全平台总算力达到 99 TOPS,并且原生支持英特尔 OpenVINO 工具套件,这也让本文所说的“在个人 PC 上本地部署 AI 大模型”成为了可能。

一、理论性能测试

本文所使用的笔记本电脑配置如下,无独立显卡。

测试使用的笔记本为 Intel Core Ultra 9 285H 处理器,TDP 45W。

CPU-Z 单核 837.6 分,多核 10917.1 分。

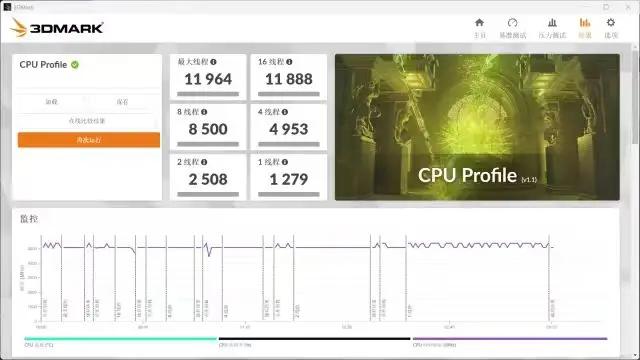

3DMark CPU Profile 分数如图。

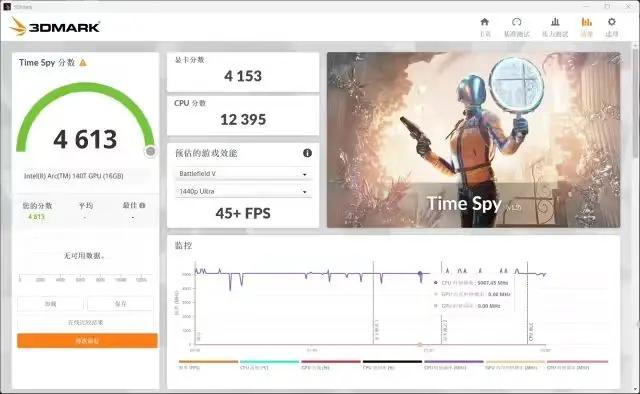

3DMark Time Spy CPU 分数 12395 分,显卡分数 4153 分。

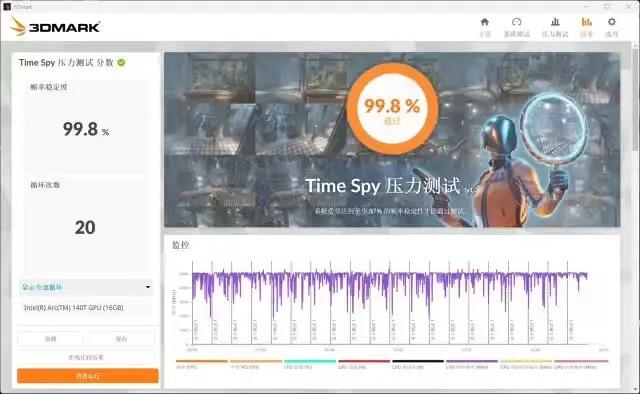

Time Spy 压力测试 20 轮循环稳定度 99.8%。

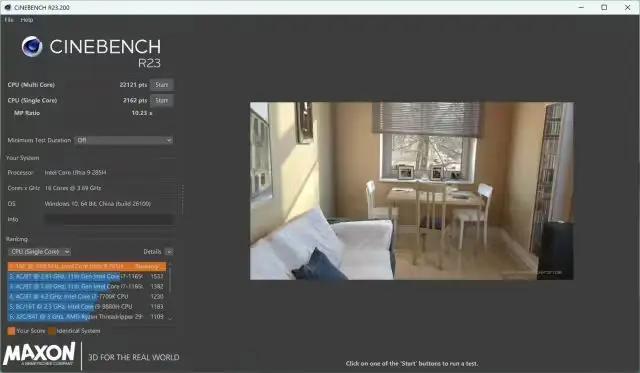

Cinebench R23 单核 2162 分,多核 22121 分。

二、AI 测试

1、deepseek 本地部署

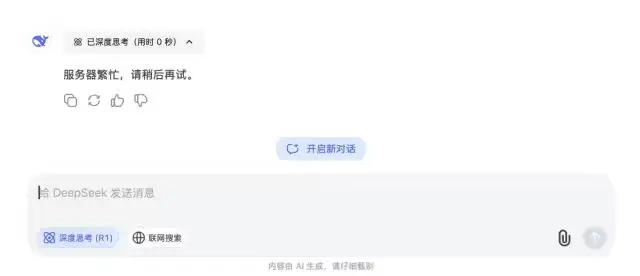

最近 deepseek 应该已经是许多人工作和生活中不可或缺的“小助手”了,因为它的确能够带来很多便利。不过另一方面,下面这个场景大家也一定熟悉又无奈。

毕竟使用者数量庞大,且仍然在迅速增加,连续发问,deepseek 难免就会出现服务器繁忙的情况。这也让 deepseek 原本为我们节省下的宝贵时间,难免又被浪费掉。

不过很多人可能对 deepseek 了解不多,相比传统 AI 的监督学习框架,deepseek 采用强化学习技术,赋予模型真正的推理能力,显著提升了数学和逻辑测试中的表现,同时降低 60% 的无效训练,优化了计算效率。

此外,通过 MoE 架构实现模型参数的动态分配,结合多层级注意力机制(MLA),在提升响应速度的同时降低了算力成本,例如在相同参数规模下推理速度提高 40%,最主要的它还是个开源模型,因此以高性价比和强大的推理能力迅速吸引全球开发者,形成技术社区裂变效应。

这些优势,也让它区别于此前的其它大模型,只能借助云端大规模的服务器算力进行部署,而是完全有希望在个人 PC 上进行本地部署。

本文提供两种部署方式,分别为 Ollama 客户端和 Flowy AIPC 助手,前者部署步骤稍多,不过部署完成后的交互界面有多种可选(命令行、浏览器插件、独立 App 均可),使用相对灵活;后者则一站式图形化操作,安装完成后使用也是在固定的独立 App(Flowy AIPC 助手)中,省心不过样式相对固定,大家可以查看教程后根据喜好自行选择。

1)驱动更新

由于本地大模型的部署需要用到 Arc 核显的计算模块进行加速,因此在开始部署前,一定要确保显卡驱动为最新版本。直接去 intel 官网下载驱动管理软件就好,这里把链接给大家放在下边了,下载前要确认好对应的处理器版本和系统版本。

下载链接:

https://www.intel.cn/content/www/cn/zh/download/785597/intel-arc-iris-xe-graphics-windows.html

下载完成后一路下一步安装,然后按指示更新到最新即可。

2)Intel 优化版 Ollama+IPEX-LLM 部署教程

a) 模型部署

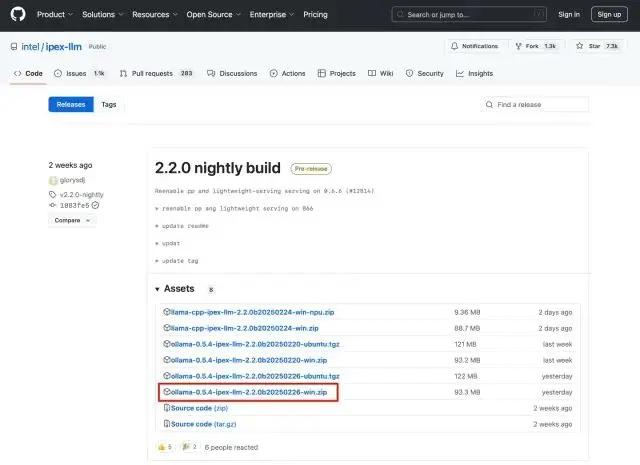

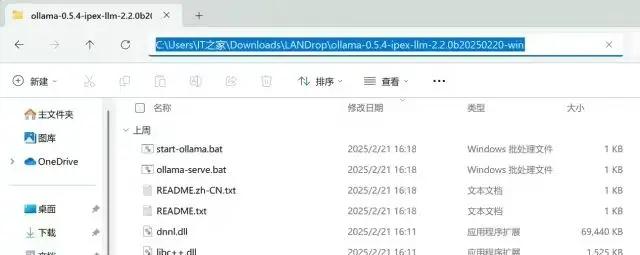

接下来就是下载 Intel 优化版 Ollama+IPEX-LLM 文件了,文件不大,可以自行到 GitHub 下载。

下载链接:https://github.com/ intel / ipex-llm / releases

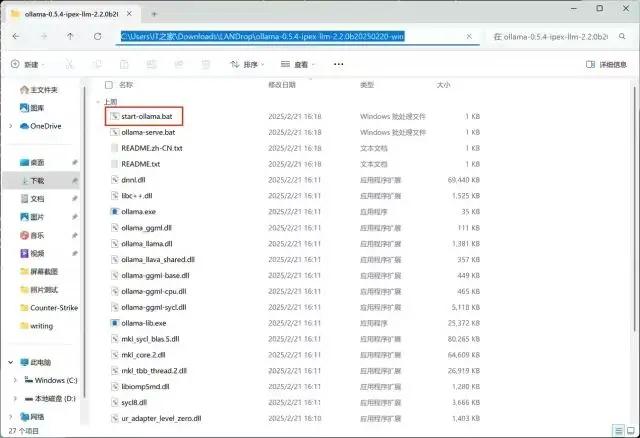

后续版本可能会有更新,大家安装时下载对应的最新版即可。下载后解压缩,左键双击运行 start-ollama.bat 文件。

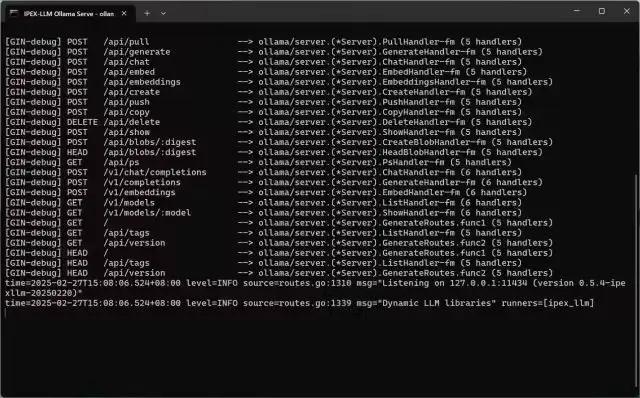

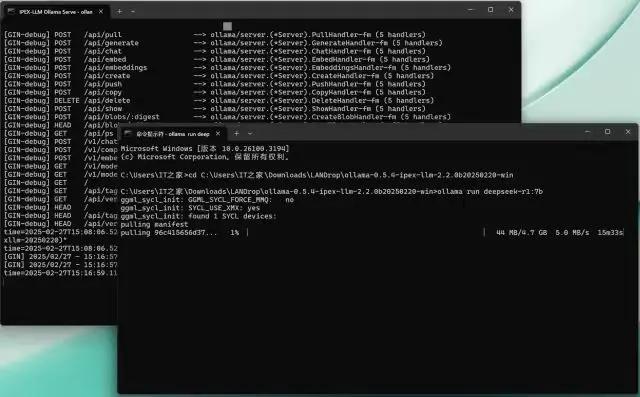

运行后会弹出如下命令行窗口:

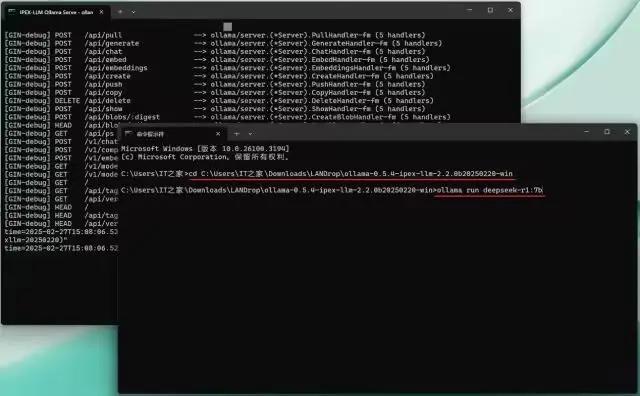

这里不要关闭上面的窗口,同时打开一个新的命令提示符(CMD)窗口,不会找 CMD 的可以直接任务栏搜索。打开后依次运行如下两条命令,注意,第一条命令需要针对大家电脑上文件保存 Ollama 的位置修改后输入。

cd C\ 修改为你解压后文件的位置ollama run deepseek-r1:7b如此处小编要输入的两条命令就是:

cd C\Users\IT之家 \Downloads\LANDrop\ollama-0.5.4-ipex-llm-2.2.0b20250220-winollama run deepseek-r1:7b

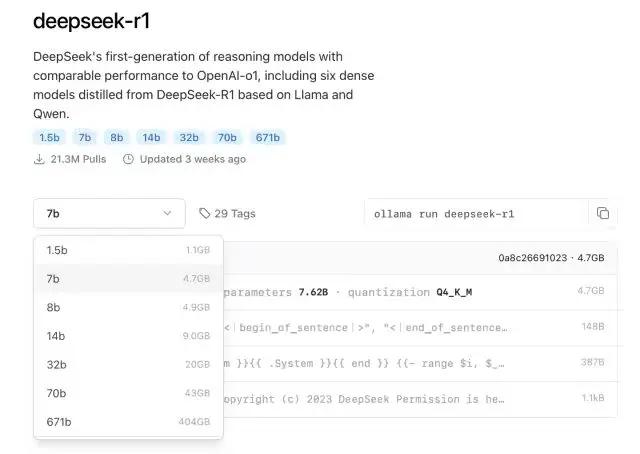

这里第二条命令中 deepseek-r1:7b 最后的 7b 指的就是所选的模型规模了,下面附上不同规模模型的文件大小,个人电脑建议大家部署 14b 以下的模型,此处小编所使用的电脑显存为 16GB,选择 7b 模型,供大家参考。

代码输入完成后,就会开启下载了,保持网络畅通耐心等待就好。

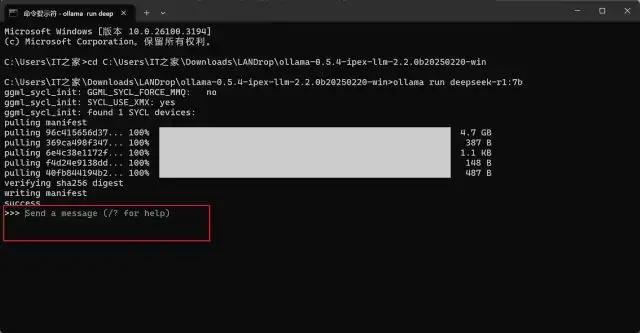

下载完成后,模型的部署就已经完成了,此处就已经可以在对话框中输入问题与 deepseek 进行问答了。

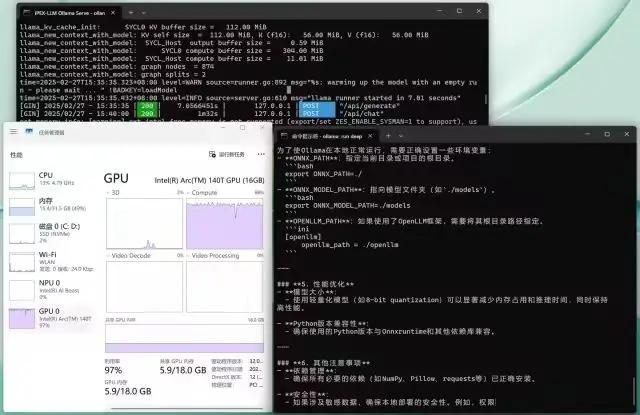

可以看到,此处向 deepseek 提出问题,便会调用 Arc 核显的计算模块进行加速,这也是目前英特尔酷睿 Ultra 处理器的 Arc 核显在移动端 AI 领域独有的优势。

此处的交流也完全不用担心“服务器繁忙”了,即问即答,全部本地运行。不过这个非常极客的交互方式,想必很多人还是不能接受的,别急,我们下一步就聊聊怎么让它变“美”。

b) 浏览器插件安装

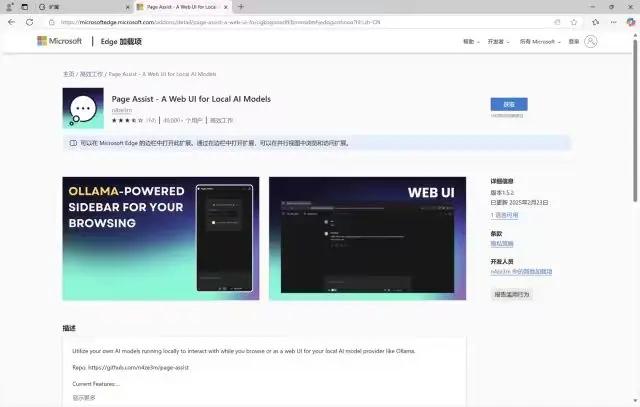

前文说过,基于 Ollama 的大模型有三种交互方式,分别是命令行、浏览器插件和独立 App,接下来我们就说说后面的两种方式。使用 Edge 浏览器和 Chrome 浏览器的小伙伴,可以到扩展中找到 Page Assist 这个插件

找到后点击获取,插件会自动下载、安装。安装好后浏览器右上方会有弹窗提醒。

打卡安装好的插件,能够看到简洁的对话窗口,画面中间绿点处标识本地模型正常加载。

在顶部选择好对话模型以后,就能够开始正常对话啦。

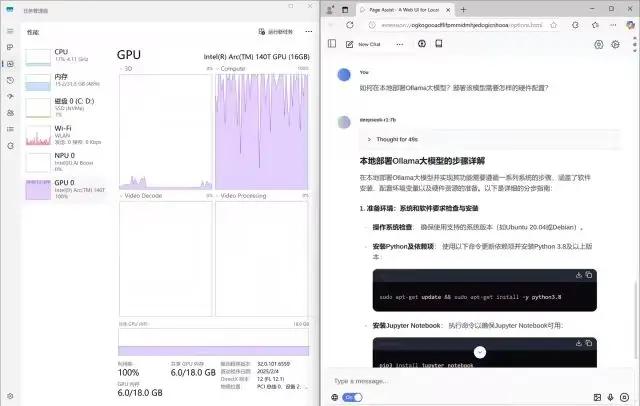

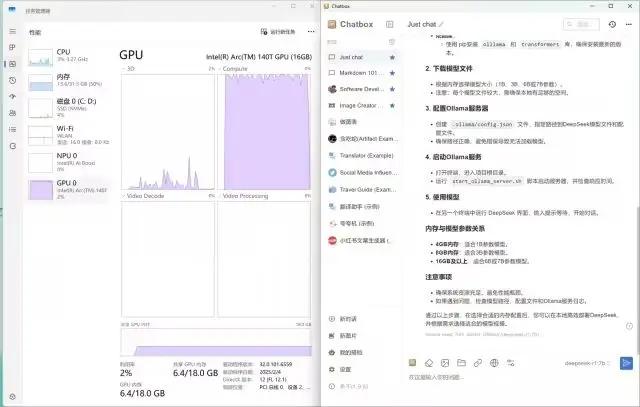

这次的问答界面就友好多了,并且基于大家每天都要使用的浏览器,方便快捷。提问后从系统资源管理器能够看到,本地 Arc 核显的计算模块已经被调用进行加速。

c) ChatBox AI 客户端安装

如果对浏览器的对话插件满意,就不用看这一部分了,如果使用的不是上述两个浏览器,抑或是对浏览器的交互方式不甚喜欢,那么也可以选择 ChatBox AI 作为交互入口。可以从官网自行下载。

官网地址:https://chatboxai.app/zh#download

文件不大,下载很快,下载完成后一路下一步安装即可,此处就不赘述了。

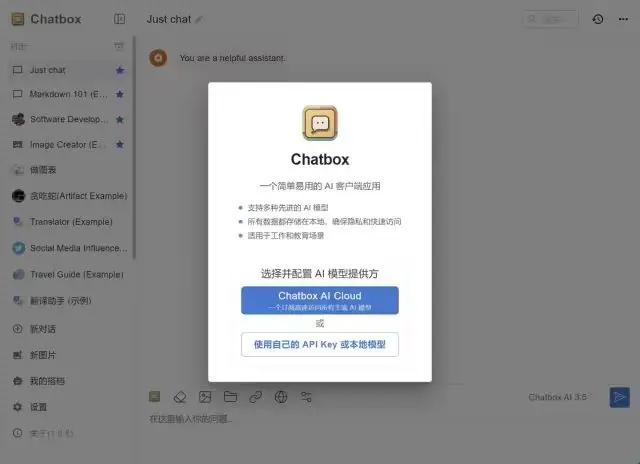

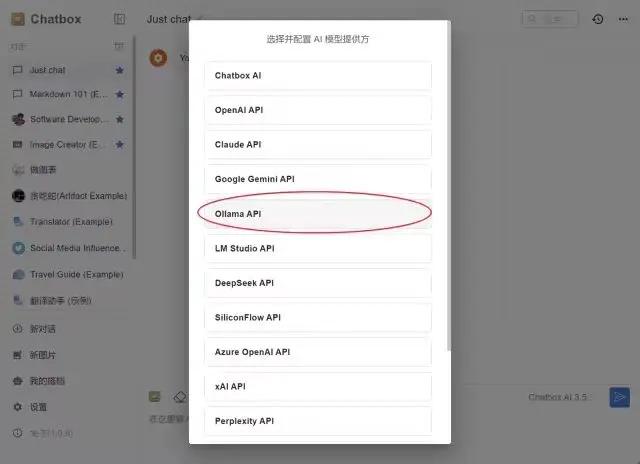

安装完成后打开会请求选择配置,此处选下面的“使用自己的 API Key 或本地模型”即可。

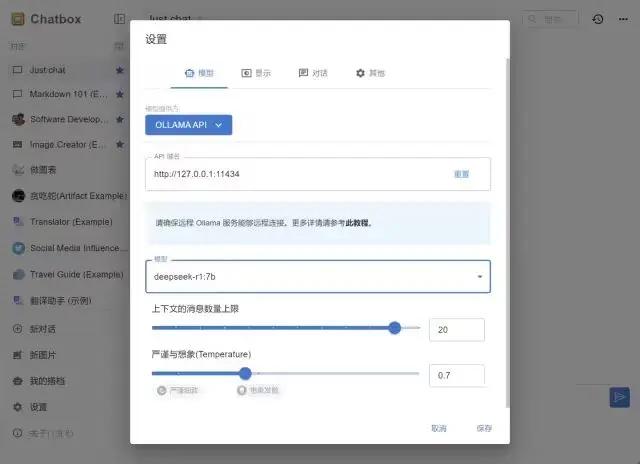

选择 Ollama API。

模型详细设置,不用修改,默认就好。

选好后就可以开始对话啦,提问后同样可以看到,调用的依旧是刚才部署的本地模型,依旧会跑满 Arc 核显的计算模块进行加速。

那么使用 Ollama 的本地模型部署以及三种交互方式到这里就都 OK 了,大家可以根据自己的喜好和需求自行选择。

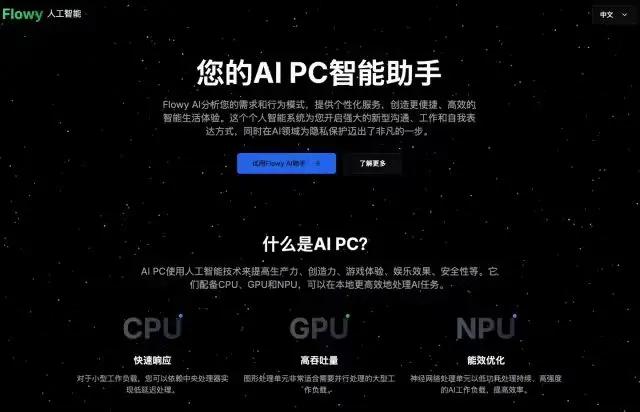

3)Flowy AIPC 助手

前一种方式如果大家觉得麻烦的话,还有一种“一站式”的全图形化部署方式就是 Flowy AIPC 助手,大家可以根据需求自行选择。首先从官网下载 Flowy AIPC 助手。

官网链接:https://www.flowyaipc.com

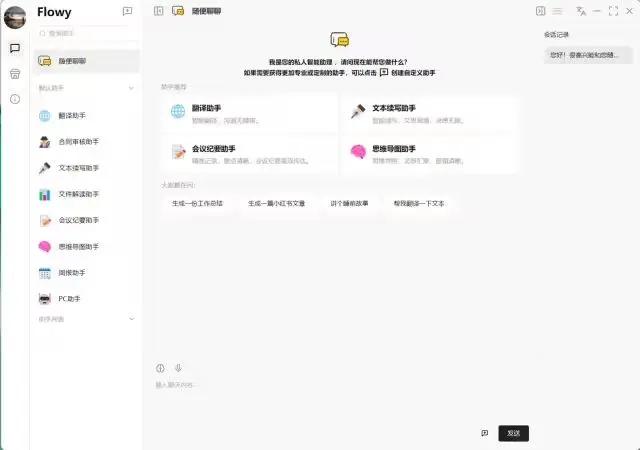

下载完成后一路下一步安装,首次打开后需要微信扫码注册登陆。登陆后就能进入看到主界面了。

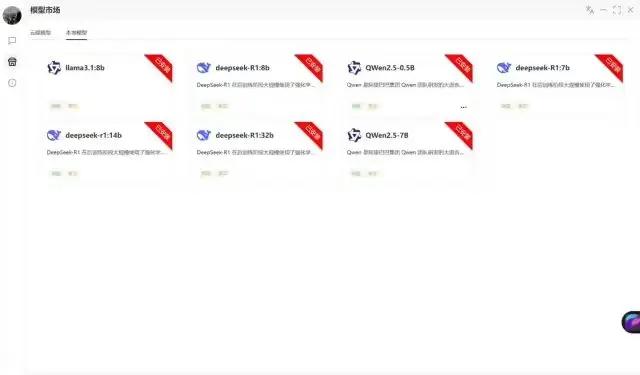

在左侧选择模型市场,可以看到提供了多个模型可选,前文部署好的 deepseek-R1:7b 模型已经识别出来并显示为已安装,如果没有部署过,就可以在这里直接点击下载。

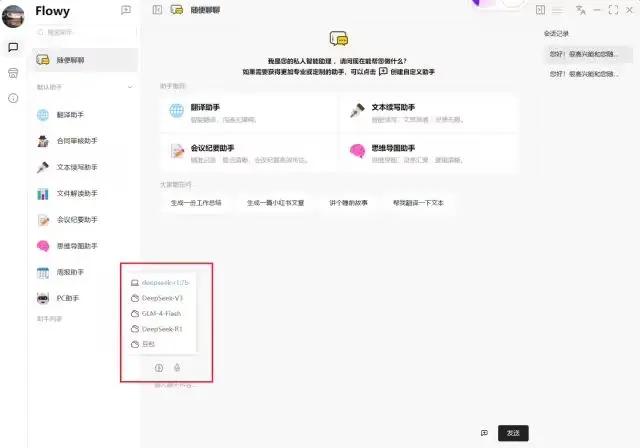

下载完成后,回到主界面就可以选择模型开始对话了,这里需要注意的是,除了本地模型,Flowy AIPC 助手还提供了云端模型可选,选择的时候要注意区分前面的小图标,分辨本地模型和云端模型。

下载完成后在 Flowy AIPC 助手中提问,可以看到同样调用了 Arc 核显的计算模块进行加速。

2、Moonlight 本地部署

Moonlight 作为月之暗面 Moonshot 开源的第一款大模型,拥有 16B 的完整参数和 3B 的激活参数,也就是说,只需平台拥有 3B 对应的算力即可使用 16B 完整性能,降低了大语言模型的使用门槛,可以说是 AI 平权的重要一步。

1)安装并部署环境

本文系作者在时代Java发表,未经许可,不得转载。

如有侵权,请联系nowjava@qq.com删除。