谷歌Gemini发布,为迄今规模最大、能力最强多模态大模型,多方位碾压对手, 手机直接可用

多模态,还是多模态。

丢出一枚“延迟发布”烟雾弹后,谷歌出其不意,在深夜憋了个大的,于当地时间12月6日提前发布了自研大模型Gemini——ChatGPT的最有力竞争对手。

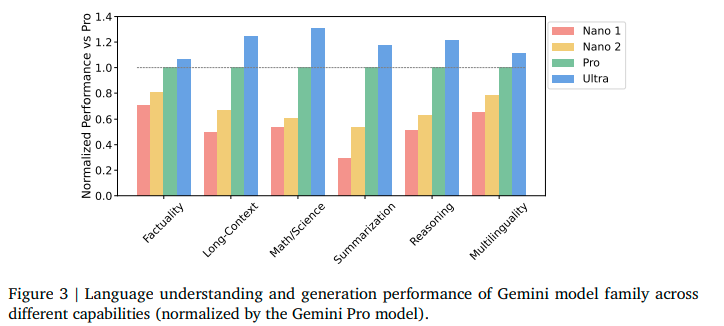

Gemini实际上是一个人工智能模型家族:“大杯”Gemini Ultra、“中杯”Gemini Pro、“小杯”Gemini Nano,都支持上下文32K理解。

Gemini三种版本的能力对比图

其中,Gemini Ultra主要是为数据中心和企业应用设计,以其强大的原生多模态性能,再次引发了大家对通用人工智能的想象。

▌原生多模态碾压ChatGPT

多模态从一开始就是谷歌大模型框架的一部分。

OpenAI当下最强大的大模型GPT 4也号称多模态模型,它是怎么实现的呢?不是直接训练一个多模态模型,OpenAI先分别训练了纯文本、纯视觉和纯音频模型,然后将他们拼接在一起。

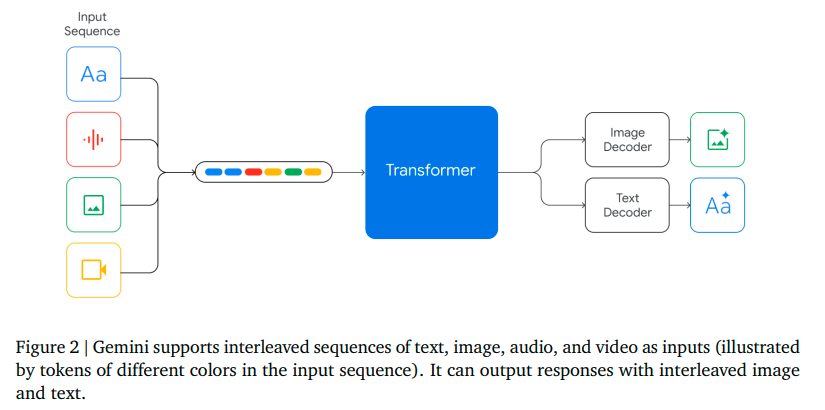

而谷歌从一开始就建立了一个“多感官”模型,给其“投喂”多模态数据(包括文字、音频、图片、视频、PDF文件等)进行训练。随后,研究人员又用额外的多模态数据进行了微调,进一步提升了模型的有效性。

Gemini支持输入文本、图像、音频和视频,输出图像和文字

基于此,谷歌称其多模态为原生多模态(natively multimodal),可以“无缝”理解、操作和组合不同类型的信息,拥有了强大的交互能力。

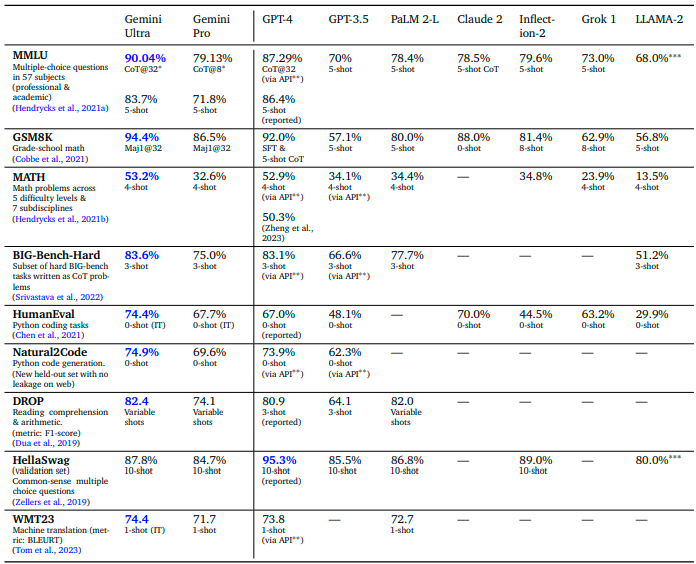

为了证明自己的产品比OpenAI的ChatGPT更出色,谷歌甩出了数张成绩单。

据谷歌介绍,从自然图像、音频、视频理解到数学推理,Gemini Ultra在32个常用的学术基准的30个上领先GPT 4。而在MMLU(大规模多任务语言理解)测试中,Gemini Ultra以90.0%的高分,成为第一个超过人类专家的模型。

MMLU测试包括数学、物理、历史、法律、医学和伦理等57个学科,旨在考察世界知识和解决问题的能力。

▌多模态的意义——为人形机器人铺路 更贴近AGI

通用人工智能(AGI)是具备与人类同等智能、或超越人类的人工智能,实现通用人工智能是AI领域的终极目标。这样的AI可以实现自我学习、自我改进、自我调整,进而解决任何问题而不需要人为干预,拥有多模态能力是前提条件。

谷歌DeepMind已经在研究如何将Gemini与机器人技术结合起来,与世界进行物理交互。据Wired报道,DeepMind首席执行官、Gemini团队代表德米斯哈萨比斯(Demis Hassabis)表示,真正的多模态需要包括触摸和触觉反馈,将这类多模态模型应用于机器人技术能催生很多可能性,“随着时间的推移,Gemini的多模态能力将提升,其将获得更多的感官,包括触觉,我们正在对此进行深入探索。”

这意味着,Gemini可以真正用人类的方式理解周围的世界,接收各种类型的数据,包括文字、代码、音频、图像、视频,并给出同样多样化的响应,包括操纵机械臂给出动作回应,人类离通用人工智能更近了一步。

▌用于端侧设备的最高效模型 可在安卓设备上本地离线运行

谷歌表示,Gemini还是他们迄今为止最灵活的模型,能够高效地运行在数据中心和移动设备等多类型平台上。

端侧运行任务交给了Gemini Nano。Gemini Nano是通过对其他模型蒸馏得来的4位模型,号称用于端侧设备最高效的模型,可以在安卓设备上本地离线运行,Pixel 8 Pro的用户马上就能体验到。Gemini Nano有两种型号,Nano-1(18亿参数)和Nano-2(32.5亿参数)——分别针对低内存和高内存设备。

Pixel 8 Pro在录音机应用中使用Gemini Nano来总结会议音频,即使没有网络连接也可以实现

谷歌表示,得益于Gemini Nano,AI可以在更多样的设备、平台上运行,每个人都可以贴近AI。

Gemini Nano目前仅适用于Pixel 8 Pro上的Android 14。

▌一些多模态应用实例

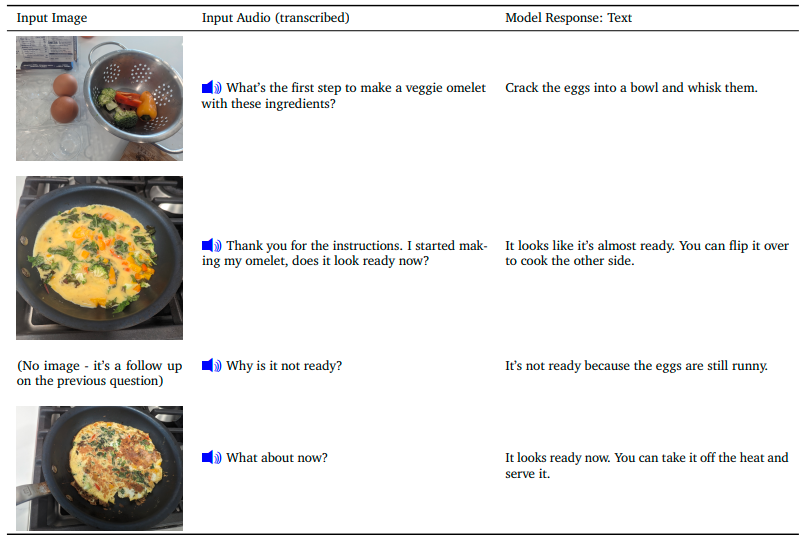

Gemini会结合语言询问,以及配图中的食材,手把手教你该怎么做菜:

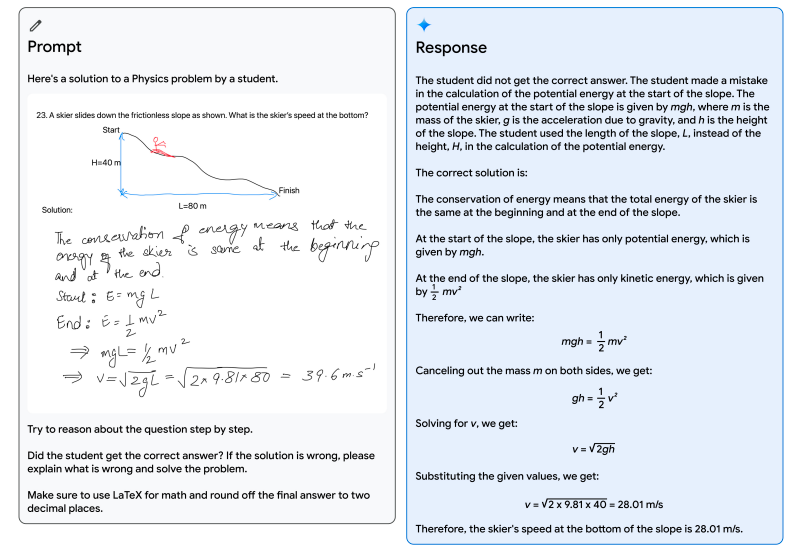

Gemini特别擅长对数学和物理等复杂学科的问题进行推理。举个例子,一位老师给出了一个物理问题“计算滑雪者在斜坡底部的速度”,一位学生提出了一个解决方案来。利用Gemini的多模态推理能力,该模型能够识别手写内容、理解问题,将问题和解决方案都转换为数学公式,找出出学生在解决问题时出错的具体推理步骤,最后给出问题的正确解决方案。

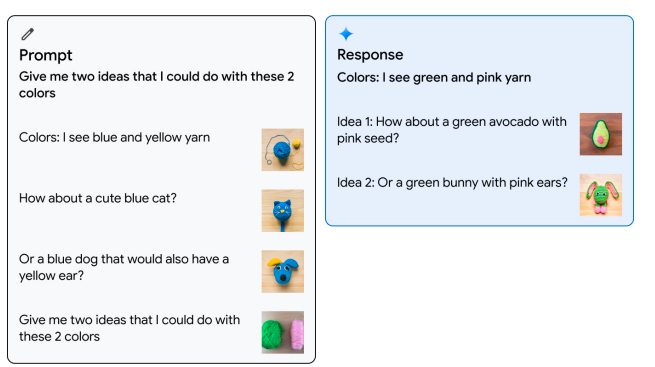

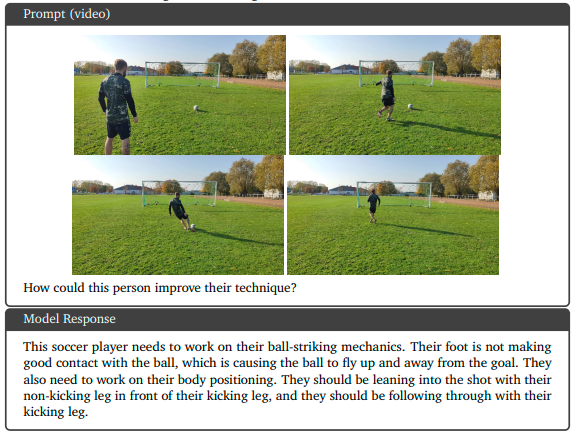

Gemini展示的其他多模态(以下例子中,输入包括图片、图表、视频、文字)理解能力:

Gemini猜对了纸团在最左边的杯子里

看图定位能力

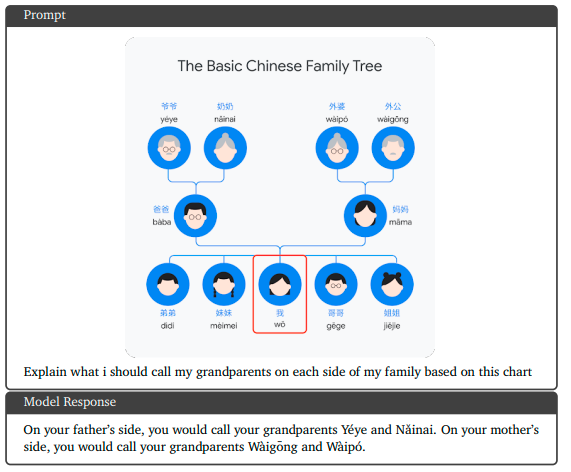

厘清人物关系图谱

图像生成能力

分析视频为球员提供建议

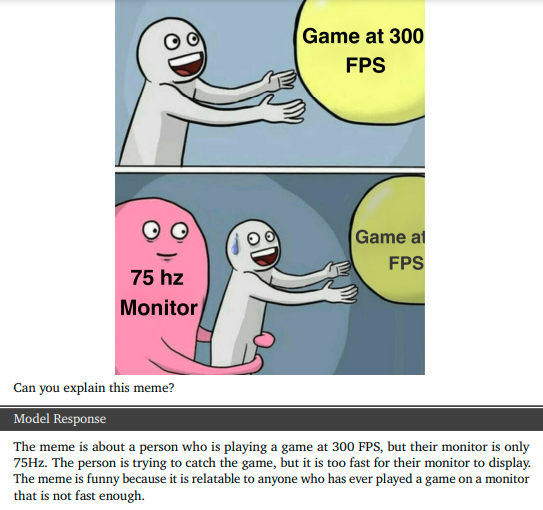

理解网络梗图

▌何时可用?

目前,谷歌没有进行现场展示,也没有开发对外测试,实际效果依然要打一个问号。

从发布日起,Gemini可开始应用于Bard和Pixel 8 Pro智能手机,在接下来的几个月中,Gemini将陆续出现在谷歌更多的产品和服务中,包括搜索、广告、Chrome、Duet AI等等——

Bard将使用Gemini Pro的微调版本来执行更高级的推理、规划、理解等任务,这也是Bard自推出以来最大的升级,从12月13日开始,开发人员和企业客户可以通过Google AI Studio或Google Cloud Vertex AI中的 Gemini API访问Gemini Pro;

Pixel 8 Pro将是第一款运行Gemini Nano的智能手机,该手机于10月4日正式发布,是谷歌最新一代高端旗舰机。安卓开发人员可以通过AI Core使用Gemini Nano进行构建。Android AICore是Android 14中的一项新系统服务,可处理模型管理、运行时、安全功能等,简化用户将AI融入应用程序的工作。

而对于“王炸”版本Gemini Ultra,谷歌表示,其目前正处于信任和安全检查阶段,包括由受信任的外部方进行红队检查,并在广泛使用之前使用微调和基于人类反馈的强化学习(RLHF)进一步完善模型。在这个过程中,谷歌会先向部分客户、开发人员、合作伙伴以及安全和责任专家提供Gemini Ultra,供其进行早期实验和反馈,然后在明年初向开发人员和企业客户推出。

本文系作者在时代Java发表,未经许可,不得转载。

如有侵权,请联系nowjava@qq.com删除。